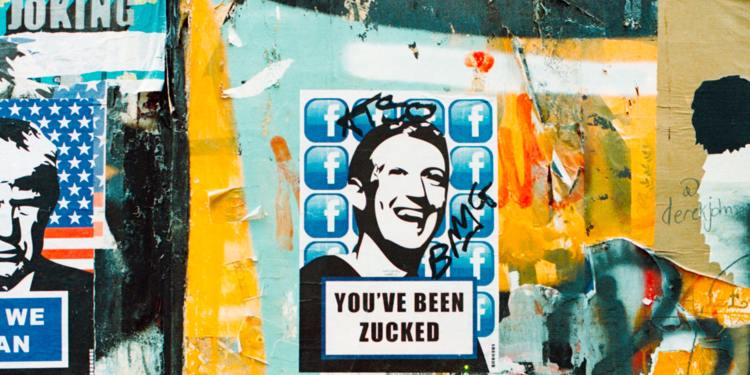

XCheck estaba destinado a mejorar la moderación, pero en cambio ha demostrado que Facebook da prioridad a personas seleccionadas.

Facebook mantiene un programa expansivo que exime a los atletas, políticos y otros usuarios de alto perfil de su típico proceso de moderación, según The Wall Street Journal. El programa está destinado a detener los "incendios de relaciones públicas" o la mala prensa causada por la eliminación de fotos, publicaciones y otro contenido de usuarios de alto perfil que deberían haber podido permanecer activos. El programa simplemente permite que estos usuarios rompan las reglas de formas que hubieran metido en problemas a la mayoría de las personas, según el informe.

El programa se conoce como XCheck, o "verificación cruzada", y está destinado a proporcionar un control de calidad adicional en torno a la moderación cuando se trata de usuarios de alto perfil, según el Journal. Se supone que las publicaciones de los usuarios marcados para XCheck se envían a un conjunto de moderadores mejor capacitados para garantizar que las reglas de Facebook se apliquen correctamente. Pero el programa protegió a 5,8 millones de personas a partir de 2020, y solo el 10 por ciento de las publicaciones que llegaron a XCheck son revisadas, según un documento visto por dicho periódico.

Los usuarios de alto perfil protegidos por el programa incluyen al expresidente Donald Trump, Donald Trump Jr., la senadora Elizabeth Warren y Candace Owens, según el informe. Los usuarios generalmente no saben que se les está dando un trato especial, dice el informe.

Facebook dijo que las críticas a XCheck estaban justificadas y que la compañía está trabajando para arreglar el programa. El sistema está destinado a "hacer cumplir con precisión las políticas sobre el contenido que podría requerir una mayor comprensión", dijo un portavoz. Agregaron que "Facebook mismo identificó los problemas con verificación cruzada y ha estado trabajando para solucionarlos".

Andy Stone, gerente de comunicaciones de políticas de Facebook, respondió más tarde a la historia del Journal en Twitter. Stone dijo que el sistema se había divulgado en el pasado, con un enlace a una publicación de blog de 2018 donde Facebook explica que tiene un sistema de "verificación cruzada" para ofrecer una "segunda capa de revisión" para las cuentas de alto perfil.

Si bien los detalles agregados del Journal no se ven muy bien para Facebook, que ha prometido incluso hacer cumplir sus reglas, hay un nivel en el que nada de esto es particularmente sorprendente. Facebook tiene un conjunto extenso y detallado de políticas de moderación. Pero siempre ha estado claro que esas políticas se aplican a discreción de Facebook, con un margen de maniobra a menudo otorgado a nombres importantes o contenido cuestionable cuando la eliminación podría generar problemas para la empresa. Con el informe, es evidente que, en algunos casos, el propio sistema de Facebook, por diseño o no, está ayudando a mantener algunas de esas publicaciones en línea.